Elon Musks Ansicht über LIDAR (die 3-D-Bildtechnologie) für das Selbstfahren ist allgemein bekannt. Er plant nicht, sie bei Tesla einzusetzen, und nennt sie eine Krücke. TSLA Dies ist eine umstrittene Ansicht, und nur die Geschichte wird zeigen, ob sie bei dieser Wette gut abschneiden.

Ein Ansatz, den Tesla gefördert hat, ist das, was manchmal als pseudo- oder virtuelles LIDAR bezeichnet wird. Dabei werden Werkzeuge gebaut, um Kamerabilder (entweder stereo oder normal) aufzunehmen und herauszufinden, wie weit jedes Pixel im Bild entfernt ist. Ein LIDAR ermittelt die Entfernung zu jedem Pixel, indem es tatsächlich zeitlich misst, wie lange der Lichtimpuls braucht, um auf das Pixel zu treffen und mit Lichtgeschwindigkeit zurück zu kommen. Der Mensch hingegen schätzt die Entfernung mit Hilfe seines Gehirns. Wir wissen, wie groß die Dinge sind und wie sie sich bewegen, und das gibt uns einen Anhaltspunkt dafür, wie weit sie entfernt sind. Wir wenden auch einige andere Tricks an, wie zum Beispiel das Stereosehen, das durch zwei Augen entsteht, aber das funktioniert nur bis zu einer mittleren Entfernung. Ein weiterer guter Trick ist die „Bewegungsparallaxe“, bei der Sie verfolgen, wie sich die Dinge vor dem Hintergrund bewegen, was Ihnen andere Anhaltspunkte gibt.

Das alles ist großartig, und menschliche Gehirne sind dieser Aufgabe gewachsen – tatsächlich kann man das beim Fahren mit einem geschlossenen Auge ziemlich gut machen. Man versucht, Techniken des maschinellen Lernens mit neuronalen Netzen zu entwickeln, um auch die Entfernung zu einem Bild herauszufinden. Dies ist ein virtuelles LIDAR.

Das Training Ihres virtuellen LIDAR ist viel einfacher als das Training vieler neuronaler Netze. Normalerweise erfordert das Training viele Trainingsbilder, bei denen Menschen in mühevoller Kleinarbeit die wahren Entfernungen herausgefunden haben. Da ein Testwagen mit einem tatsächlichen, teuren LIDAR ausgestattet sein kann, können Sie herumfahren, um Trainingsdaten in Kombination mit den „ground truth“-Entfernungsangaben aus dem LIDAR zu erhalten. Man zeigt dem neuronalen Netz tonnenweise Bilder mit der vom LIDAR berechneten tatsächlichen Entfernung, und es wird gut darin, die Entfernung selbst herauszufinden. Diese Technik, eine Variante des „unbeaufsichtigten Lernens“, weil man keine menschlichen Tagger braucht, ist wesentlich billiger als das überwachte Lernen, wenn es also etwas gibt, was Neuronale Netze gut können, dann dies. Sie können auch mit Simulatordaten trainieren, um Ihre Modelle zu verbessern.

Ein Problem mit neuronalen Netzen ist, dass sie dazu neigen, Einzelbilder zu betrachten, und nicht ein bewegtes Bild, wie es Menschen tun. Menschen machen bei Standbildern tatsächlich eine Menge Fehler. Mit der Zeit werden die Techniken des maschinellen Lernens dies vielleicht überwinden. Das Problem ist, dass wir daraus eine „Bet your life“-Zuverlässigkeit gewinnen müssen. Man muss das auch bei Dingen tun, die man noch nie zuvor gesehen hat, etwas, das neuronale Netze herausfordern kann. Ein Beispiel dafür ist etwas Ungewöhnliches, das auf Ihrer Fahrspur auf der vor Ihnen liegenden Straße angehalten wurde. Sie müssen wissen, wie weit es entfernt ist, und Sie müssen es super zuverlässig und schnell herausfinden. Wenn es sich um ein Auto handelt, wissen Sie, wie groß Autos sind, also wissen Sie auch, wie weit es entfernt ist. Genau wie ein Auto, das sich seitwärts dreht – für einen Menschen – aber eine Trainingsdatenbank hat das vielleicht noch nie gesehen. Bei einem zufälligen Objekt fragt man sich: Ist das ein großes Objekt weit weg oder ein kleines Objekt in der Nähe? Das lässt sich nur feststellen, wenn man seine Beziehung zur Geometrie der Straße sieht. Das ist komplexer.

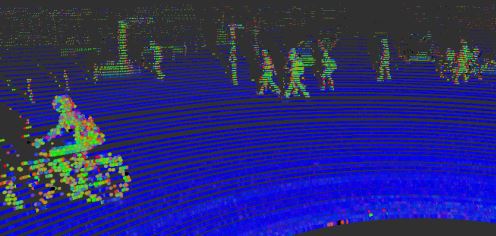

Wenn jemand dies schafft, wird er ein Werkzeug haben, das Kamerabilder aufnehmen und die 3D-„Punktwolke“ erzeugen kann, die ein LIDAR erzeugt, und da Kameras billiger sind, wird es dies zu viel geringeren Kosten tun. Möglicherweise können sie dies auch bei sehr großen Entfernungen tun. Viele LIDARs sehen nur bis zu etwa 120 m weit. Teure Lidars sehen 240 m. Die Menschen sind dafür bekannt, dass sie verstehen, was sie auf eine Meile Entfernung sehen.

Hier liegt die Ironie. Die Entwickler, die sich auf LIDAR festgelegt haben, haben ihre Systeme so gebaut, dass sie von diesen Punktwolken abhängen, und haben viel Zeit damit verbracht, dies zu verfeinern. Wenn plötzlich ein Pseudo-0-LIDAR-System verfügbar wird, das qualitativ hochwertige Punktwolken erzeugt, können sie es sofort nutzen. Diejenigen, die auf das Pseudo-LIDAR gehofft haben, werden nicht die gleiche Erfahrung mit der Verwendung von Daten in dieser Form haben. Stattdessen werden sie Pläne haben, die anderen Elemente ihres Sehsystems (Segmentierung des Bildes in verschiedene Objekte und deren Klassifizierung) mit der Entfernungsschätzung zu kombinieren. Möglicherweise werden sie weniger gut ausgerüstet sein, um den erhofften Durchbruch zu nutzen.

Die LIDAR nutzenden Unternehmen werden dagegen nur sagen: „Toll, wir können das teure LIDAR durch etwas Billigeres ersetzen“. Wenn es sich dabei um Unternehmen handelt, die LIDAR herstellen (wie Ford, Cruise, Waymo und Aurora), haben sie vielleicht das Gefühl, etwas Geld verschwendet zu haben.

Klar ist, dass man die Entfernung zu allem, was auf der Straße liegt, lernen muss, und man muss sie richtig einschätzen, und das muss man schnell tun. Wir haben bereits mehrmals gesehen, wie der Tesla-Autopilot in Lastwagen, eine Leitplanke und abgewürgte Fahrzeuge in der Fahrspur vor uns krachte, die von einem plötzlich aus dem Weg fahrenden Auto verdeckt wurden. Wenn Ihren Sensoren plötzlich und überraschend ein Hindernis auf der Straße angezeigt wird, müssen Sie wissen, wie weit es mit hoher Zuverlässigkeit bewusst ist, damit Sie eine Notbremsung einleiten können. LIDAR tut dies so ziemlich immer, aber die Computervision tut es nicht. Pseudo-LIDAR ist ein Versuch, dieses Problem zu beheben – aber im Moment planen die meisten anderen Firmen, es mit LIDAR zu lösen, von dem sie wissen, dass es funktioniert, und von dem sie erwarten, dass es billig wird.

Das ist ein weiterer Schritt für Eleon Musk zu einem SW Unternehmen zu werden, wenn seine Lösungen auch zu Sensorik mit anderer HW passen.

Wenn Sie bei Tesla-Car-Rent aktuell (April 2020) ein Elektroauto vom Tesla mieten, dann können Sie nur wenig von autonomen Funtionen nutzen. Ein SW update gibt es aber fast jede Woche, d.h. man ist sich nie sicher was man wirklich fährt, wenn man einsteigt. Mieten Sie hier einen Tesla und finden es heraus.